MCP, UCP et ACP sont des sigles qui s’sont progressivement intégrés au discours technologique du secteur hôtelier à mesure que progresse l’adoption de l’intelligence artificielle. Dans ce qui suit, nous les approfondirons pour comprendre ce qu’ils représentent, quel rôle ils jouent dans ce nouveau paysage et pourquoi ils commencent à gagner en importance dans les conversations sur la distribution et la technologie, même s’il s’agit d’un terrain qui reste incertain.

Car lorsqu’on aborde l’irruption des assistants d’intelligence artificielle dans la distribution hôtelière, le discours commercial tend à se construire sur une prémisse récurrente : la supposée nécessité pour chaque hôtel d’adapter son funnel de réservation directe à ce nouveau contexte. Une affirmation qui mérite d’être nuancée et analysée avec prudence, en appliquant —comme presque toujours en technologie— logique et connaissance du secteur, afin de ne pas tomber dans des anticipations mal calibrées qui finissent par constituer un faux pas, avec un coût inutile tant en ressources économiques qu’en temps.

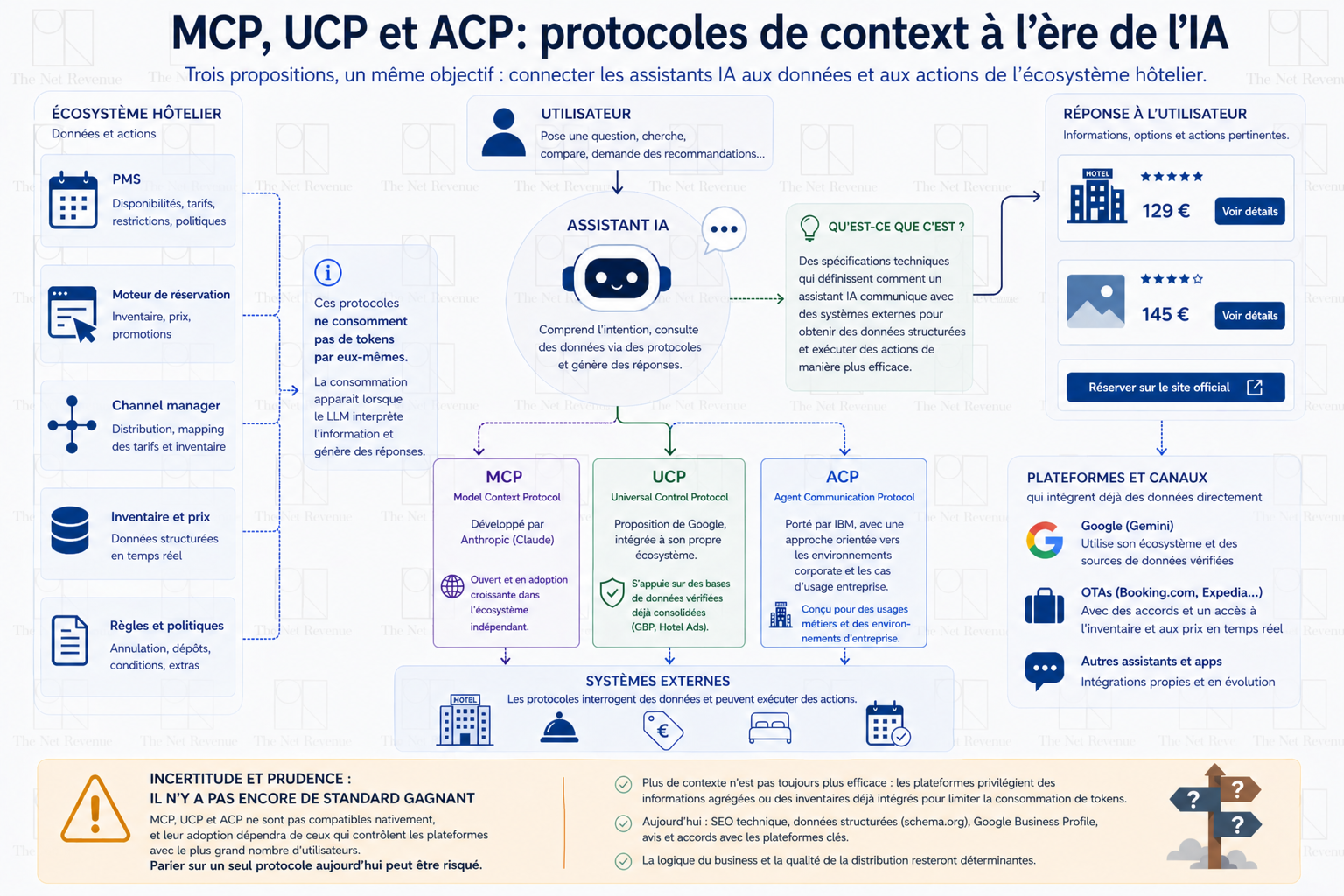

Que sont les protocoles de contexte ?

Les protocoles de contexte sont des spécifications techniques conçues pour définir comment un assistant d’intelligence artificielle communique avec des systèmes externes afin d’obtenir des données structurées et d’exécuter des actions de manière plus efficiente. Toutes proportions gardées, ils peuvent être compris comme une analogie fonctionnelle des fichiers sitemap en SEO : ils ne génèrent ni le contenu ni l’intelligence, mais facilitent aux systèmes automatisés —en l’occurrence, les assistants IA— l’accès et l’interprétation structurée de l’information pertinente.

À l’heure actuelle, les propositions qui concentrent le plus d’attention au sein de l’écosystème technologique sont :

- MCP (Model Context Protocol), développé par Anthropic (Claude), de nature ouverte et avec une adoption croissante au sein de l’écosystème indépendant.

- UCP (Universal Control Protocol), le pari de Google, intégré dans son propre écosystème et soutenu par des bases de données vérifiées déjà consolidées comme Google Business Profile ou Hotel Ads.

- ACP (Agent Communication Protocol), porté par IBM, avec une approche davantage orientée vers les environnements corporatifs et les cas d’usage en entreprise.

Il est important de comprendre qu’aucun de ces protocoles ne consomme de tokens par lui-même, bien qu’il en génère indirectement lorsqu’un modèle d’IA interagit avec l’information qu’ils exposent. La consommation de tokens se produit lorsque l’assistant incorpore ces données externes à son contexte interne pour raisonner —ce qui compte comme tokens d’entrée— et lorsqu’il génère des réponses à partir de celles-ci —tokens de sortie—, un coût qui augmente à mesure que les contenus sont plus étendus et détaillés (inventaires complets, règles tarifaires, politiques, etc.) et qui se multiplie dans les flux conversationnels avec des appels répétés. En revanche, ni le standard technique, ni l’endpoint, ni l’échange préalable entre systèmes ne consomment de tokens : un PMS peut répondre à MCP sans coût jusqu’à ce qu’un LLM interprète cette information. Cette distinction est particulièrement pertinente pour le secteur hôtelier, car plus de contexte n’implique pas nécessairement une plus grande efficience : les plateformes qui contrôlent l’accès à l’IA ont des incitations claires à minimiser la consommation de tokens et, en pratique, tendent à prioriser l’information agrégée ou les inventaires déjà intégrés au niveau de la plateforme par rapport aux protocoles individuels de chaque hôtel.

Quiconque a travaillé avec des usages professionnels de l’intelligence artificielle, au-delà des tâches basiques ou des modèles à tarif fixe, connaît bien le concept des tokens et leur impact direct sur les coûts et les limites opérationnelles. Dans le contexte des modèles de langage (LLM), les tokens sont les unités minimales de texte que le modèle traite pour comprendre et générer du langage, et constituent l’un des facteurs clés qui conditionnent aussi bien l’architecture technique que les décisions stratégiques des plateformes qui les opèrent.

Pourquoi faut-il être prudent quant à leur application dans l’écosystème technologique actuel ?

Le problème —et en même temps le risque majeur— de centrer la stratégie et le budget sur l’adoption d’un protocole de contexte est que les trois principaux modèles du marché poursuivent des objectifs similaires, mais ne sont pas compatibles entre eux. Le standard qui finira par s’imposer dépendra moins de son excellence technique que de celui qui contrôle les plateformes avec la plus grande base d’utilisateurs. C’est le schéma classique de toute guerre de standards : Betamax contre VHS, Amiga vs. PC, cartouche contre CD-ROM. Ce n’est pas le meilleur qui gagne, c’est le plus distribué. Miser tout sur un unique protocole, avec l’investissement élevé que cela implique, s’avère pour le moins téméraire à un moment où il n’existe pas encore de vainqueur clairement établi.

Il est vrai que les assistants IA réduisent drastiquement le temps d’exploration —de jours à heures—, ce qui représente une amélioration tangible pour l’utilisateur. Cependant, ils n’altèrent pas de manière substantielle la logique du processus de décision ni le lieu où se concrétisent les réservations. De plus, le modèle économique dans les phases basses du funnel continue de ne pas fonctionner, ni pour OpenAI ni pour Google. Et ce déficit est, fondamentalement, un problème des plateformes, pas de l’hôtelier.

Affirmer que les entreprises qui implémenteront aujourd’hui une infrastructure MCP seront automatiquement mieux positionnées lorsque les assistants domineront la découverte automatique est une analogie séduisante, mais conceptuellement fragile. En SEO, le standard était déjà résolu : Google était l’arbitre incontestable. Dans l’écosystème actuel des protocoles pour agents IA, le standard reste encore à décider. Cela n’invalide pas MCP comme pari d’avenir, mais rend naïf le fait de le présenter comme une certitude stratégique alors qu’il demeure, en réalité, une hypothèse parmi plusieurs en compétition.

À ce jour, les assistants IA ne peuvent pas garantir des informations fiables sur la disponibilité et les prix en temps réel, ce qui génère de l’incertitude chez l’utilisateur et le pousse à revenir vers les canaux traditionnels qu’il connaît déjà. Et le mécanisme qui résout cette limitation n’exige pas que l’hôtel implémente quoi que ce soit. Booking.com et Expedia intègrent directement leurs inventaires avec ChatGPT et d’autres assistants depuis plusieurs mois, via des accords que les hôtels individuels ne peuvent pas répliquer. Lorsque la phase de considération se déplacera effectivement vers l’environnement IA, il est fort probable qu’elle se résoudra en affichant des résultats d’intermédiaires disposant de données structurées, d’un inventaire massif et de prix en temps réel. Exactement le même schéma que celui observé avec Google : le canal direct a certes obtenu de la visibilité, mais en compétition désavantageuse face à des intermédiaires mieux préparés et dotés d’une plus grande capacité de négociation.

Il convient de rappeler que le HTML sémantique et les données structurées de schema.org sont un standard depuis des années et constituent aujourd’hui la base sur laquelle les LLM construisent leurs réponses. La gestion active de Google Business Profile alimente directement l’assistant de Google avec des informations vérifiées. La présence sur les plateformes d’avis que les assistants consultent déjà de manière systématique construit une autorité qui se transfère aux réponses générées. Ce sont des décisions à impact démontrable dès maintenant, non conditionnées à ce qu’un standard technique particulier finisse par s’imposer.

Que l’intelligence artificielle transformera la distribution hôtelière ne fait pas débat. Mais si l’on s’en tient aux données réelles, il convient d’observer l’étude de SparkToro et Datos (Semrush) publiée en 2026, qui démonte —du moins pour l’usage sur ordinateurs de bureau et portables— l’un des mantras les plus répétés récemment dans le secteur touristique : le supposé essor des recherches avec IA. Un article que nous avons déjà traité précédemment et qui peut être consulté via le lien suivant.

À l’ère de l’intelligence artificielle, ce n’est peut-être pas celui qui est le plus visible ni celui qui dispose du plus grand nombre de couches techniques qui gagnera, mais —comme cela s’est produit historiquement dans la distribution hôtelière— celui qui comprend le mieux la logique du système et administre ses ressources avec le plus de discernement. Celui qui dispose d’inventaire, de réputation et d’accords solides avec les plateformes que l’utilisateur utilise déjà. Préparer l’infrastructure technique est un pari légitime. La présenter comme la seule stratégie possible ou comme une garantie de compétitivité future est une simplification excessive que l’hôtelier prudent devrait évaluer avec toutes les nuances sur la table.